本気で「AIマーケット」を狙う半導体ベンダー:大原雄介のエレ・組み込みプレイバック(2/2 ページ)

競争激化する、組み込み機器でのDNN推論実行環境

推論に関しては来たデータをベースに判断を行う訳であり、学習よりもはるかに処理負荷は小さい。こう推論機能を組み込み機器、具体的にはセンサーハブやセンサーフュージョン機器に載せようという話が盛んになされている。

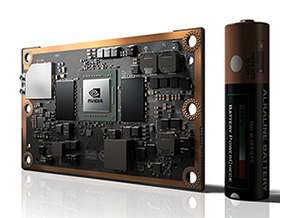

実はこれに向けても、既に多くのプレイヤーが手を上げている。まずGPUで言えば、NVIDIAが「Jetson TX1/TX2」を強力にプッシュしているし、Vivante Technology(2016年にVeriSiliconが買収)のGPGPUコアもDNN向けをアピールしている。「Mali GPU」を擁するARMはMali GPUに関して「DNN向けにも利用可能」という一歩引いた立場を崩さないが、別のDNN向けソリューションを現在準備中のためだろう。Imaginationは「PowerVR Series7XT Plus」から、DNN向けを強力にアピールしている。

ただこれらは強力な推論エンジンになりうる一方、コストと消費電力もまた高めである。そこでもっと低コストなソリューションを提案しているのがCEVAである。CEVA-XM DSPにソフトウェアフレームワークを組み合わせたCDNN(CEVA Deep Neural Network)は、MPUやGPUに比べるとずっと低コスト&低消費電力のソリューションになりえるという主張だ。Cadence傘下のTensilicaもDSPベースのIPを提供しており、他にもDSP IPを持つベンダーがやはりDNN向けのフレームワークを提供といったニュースが出てきている。

同様に、GPUに比べてずっと低い消費電力とコストを実現できるとするのがFPGAベンダーで、XilinxとAltera(Intel PSG)という2大ベンダーに加えて、小〜中容量のFPGAを提供するLattice SemiconductorとMicrosemi Corporationもこのマーケットを狙っている。

関連記事

AI時代に舵を切る半導体ベンダーの「持ち札」

AI時代に舵を切る半導体ベンダーの「持ち札」

日の丸半導体ベンダー、ルネサスが攻勢の兆しを見せている。17年度第1四半期決算は好調でありインターシルの買収も終了した。5年ぶりに開催したプライベート展で語られた、攻勢を支える「持ち札」とは何か。 アイに熱視線のエレクトロニクス、東芝の両翼を欠いた成長戦略

アイに熱視線のエレクトロニクス、東芝の両翼を欠いた成長戦略

AIにエレクトロニクス関連各社も熱い視線を送っており、2017年3月は多くの企業から発表が相次ぎました。渦中の東芝も延期した決算を3月に発表する予定でしたが、監査法人との調整が終了せずに決算発表が2度見送られる事態に。 インテルとAIとFPGAの関係、「組み込みAI」普及の施策

インテルとAIとFPGAの関係、「組み込みAI」普及の施策

人工知能(AI)は組み込みの世界にとっても、無関係な存在ではなくなりつつある。FPGA大手を傘下に収めたインテルの考える「AIとFPGAの関係」とは。 稼働中の産業機器にAIを「追加」で実装、組み込みAIを実現

稼働中の産業機器にAIを「追加」で実装、組み込みAIを実現

新規ではなく「追加」で、人工知能による予防保全を実現するソリューションをルネサスが発表した。組み込み機器でのAI利用を容易にする「e-AI」によるものだ。 「データカンパニー」に変貌する半導体の巨人、FPGAへの期待と懸念

「データカンパニー」に変貌する半導体の巨人、FPGAへの期待と懸念

「半導体の巨人」インテルが、「データカンパニー」への変貌をうたっている。先進技術と生産性を持った半導体ベンダーであることは変わりないが、その半導体をどう販売するかの戦略には大きな変化が見られる。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

会員登録がまだの方はこちら

豊富なホワイトペーパーの中から、製品・サービス導入の検討に役立つ技術情報や導入事例などを簡単に入手できます。

特集

- 設計者CAEの取り組みに関する実態

- マテリアルズ・インフォマティクスの動向調査

- 製造業のアナログ業務の実態調査

- 設計・解析業務におけるAI活用

- 製造現場におけるデータ活用の実態調査

- 3Dプリンタ利用動向調査

- CAD利用動向調査

- 研究・開発職のデジタル活用調査

- 安全安心なIoT機器実現の課題

- 電気設計者の課題と解決

- “つながる工場”の現状と課題

- 製造業におけるAI開発および活用の実態

- 設計・製造現場における品質管理

- 製造業IoTセキュリティ

- IoT時代の組み込みソフトウェア品質

- IoT時代のセキュリティリスクに備える

- 加速する工場と生産設備のデジタル化

- 製造業の省エネ対策と課題

- モノづくり設計者のワークスタイル調査

- タイアップ&セミナーコンテンツ一覧

NVIDIA「Jetson TX2」

NVIDIA「Jetson TX2」